CompanyGPT Cloud-Stack: Enterprise-KI im eigenen Azure Tenant

Warum eigene KI-Plattformen scheitern, bevor sie produktiv gehen

Die meisten Unternehmen, die eine private KI-Plattform aufbauen wollen, stranden nicht am Modell. Sie stranden am Betrieb. Authentifizierung, Berechtigungen, private Konnektivität, Compliance, Updates: Genau hier wird aus einem Proof of Concept ein endloses Projekt. Mit CompanyGPT, das wir gemeinsam mit der innFactory AI Consulting vertreiben, haben wir diesen Pfad bereits einmal sauber gebaut. Dieser Beitrag zeigt, wie der Cloud-Stack dahinter aussieht.

Die Architektur auf einen Blick

CompanyGPT läuft vollständig im Azure Tenant des Kunden. Wir liefern keinen SaaS, sondern eine reproduzierbare Plattform, die per Infrastructure as Code in Ihre Subscription deployed wird. Das Ergebnis: Sie behalten Datenhoheit, wir kümmern uns um Aufbau, Updates und Härtung.

Die Kernkomponenten:

- Azure Kubernetes Service (AKS) als Laufzeitumgebung für alle Container

- Azure Database for PostgreSQL als relationale Datenbank

- Azure Cosmos DB (MongoDB API) für dokumentenorientierte Workloads

- Private Endpoints für jede Datenbank- und Storage-Verbindung

- Azure AI Foundry für OpenAI-Modelle direkt in der Region des Kunden

- Google Vertex AI (jetzt Google Agents Platform) für Anthropic Claude und Gemini

- AWS Bedrock und STACKIT Model Serving als optionale Multi-Cloud-Optionen

- Microsoft Entra ID für SSO und Token-Propagation an MCP-Server

Azure Kubernetes Service als zentrale Laufzeit

Wir setzen bewusst auf AKS, nicht auf Container Apps oder klassische VMs. Der Grund ist die Mischung aus Workloads: Frontend, API, Worker, Vektor-Indexer, RAG-Connectoren, MCP-Server und n8n laufen parallel mit unterschiedlichen Skalierungsprofilen. Kubernetes liefert hier Standardisierung über Helm Charts, sauberes Networking über Network Policies und einen einheitlichen Operator-Layer für Logging und Monitoring.

Der AKS-Cluster wird mit Azure CNI Overlay aufgesetzt, ist privat erreichbar und nutzt Workload Identity. Damit greifen Pods auf Azure-Ressourcen ohne Secrets zu, ausschließlich über Federated Credentials. Das eliminiert eine ganze Klasse von Leaks.

Datenbanken hinter privaten Endpoints

PostgreSQL hält strukturierte Daten: Benutzer, Konversationen, Audit-Logs, Agent-Konfigurationen. Cosmos DB mit MongoDB API speichert dokumentenorientierte Inhalte wie Memory-Einträge, RAG-Metadaten und unstrukturierte Vektorbegleitdaten. Beide Datenbanken sind ausschließlich über Private Endpoints erreichbar. Es gibt keinen öffentlichen DNS-Eintrag und keinen Public-Access-Pfad.

Konkret bedeutet das:

- Datenbanken sind nicht im Internet sichtbar, auch nicht für Management-Tools

- Verbindungen laufen über Private DNS Zones, die im Kunden-VNet leben

- Backup, Failover und Geo-Redundanz bleiben über die Azure-Funktionen erhalten

- Compliance-Audits sehen exakt eine Netzwerkgrenze, nicht Dutzende

Für Kunden mit erhöhten Souveränitätsanforderungen ergänzen wir das Setup um Customer Managed Keys auf Basis von Azure Key Vault. Die Modelle und Vektorindizes lassen sich zusätzlich auf STACKIT auslagern, falls eine deutsche souveräne Cloud gefordert ist.

Terraform und GitHub Actions: Alles nachvollziehbar

Die gesamte Infrastruktur ist in Terraform-Modulen abgebildet. Jede Subscription, jedes VNet, jeder AKS-Node-Pool, jede private Zone und jede Rolle wird als Code provisioniert. Für die Anwendungs-Releases nutzen wir Helm Charts, die ebenfalls versioniert sind.

GitHub Actions orchestriert das Ganze. Pull Requests triggern Plan-Runs gegen die Zielumgebung, Reviews erzwingen Vier-Augen-Prinzip, Apply läuft erst nach Freigabe. Der Vorteil:

- Jede Änderung an der Plattform ist im Git-Verlauf nachvollziehbar

- Rollbacks funktionieren über Revert, nicht über manuelle Klickorgien

- Security-Patches an Basisimages oder Helm Charts wandern über automatisierte Pipelines aus

- Renovate aktualisiert Abhängigkeiten kontinuierlich, kein Drift bleibt unentdeckt

So bleibt die Plattform ohne offene Sicherheitslücken aktuell. Wir setzen auf moderne DevSecOps-Mechanismen wie SBOM-Generierung, Container-Scanning mit Trivy, Policy-Checks via OPA und signierte Artefakte über Sigstore.

TD SYNNEX: Microsoft Bezug ohne eigenes Vendor-Management

Als indirekter Reseller von Microsoft über TD SYNNEX kümmern wir uns um die kommerzielle Seite gleich mit. Kunden müssen keinen eigenen Microsoft-CSP-Vertrag verhandeln, kein Enterprise Agreement aufstocken und keine separaten Rechnungen verarbeiten. Wir liefern Subscription, Beratung, Implementierung und optional Wartung aus einer Hand. Mehr dazu in unserem Beitrag zu GitHub-Abrechnung über Azure.

Multi-Cloud beim Modell-Layer

Modell-Anbieter sind heute kein Monopol mehr. Wir haben CompanyGPT bewusst so gebaut, dass die Modellschicht austauschbar bleibt:

- OpenAI-Modelle wie GPT-4o und GPT-5 ziehen wir über Azure AI Foundry direkt im Tenant

- Anthropic Claude und Google Gemini liefern wir über die Google Agents Platform, vormals Vertex AI

- AWS Bedrock erschließt zusätzlich Llama, Mistral und weitere Modelle

- STACKIT Model Serving liefert Llama, Gemma und GPT-OSS auf deutscher souveräner Cloud

So entsteht das Beste aus allen Welten: Latenz und Datenresidenz aus Azure, Modellvielfalt aus GCP, Souveränität aus STACKIT, Spezialmodelle aus AWS. Die Auswahl trifft der Anwender pro Anfrage, nicht der Plattformbetreiber pro Quartal.

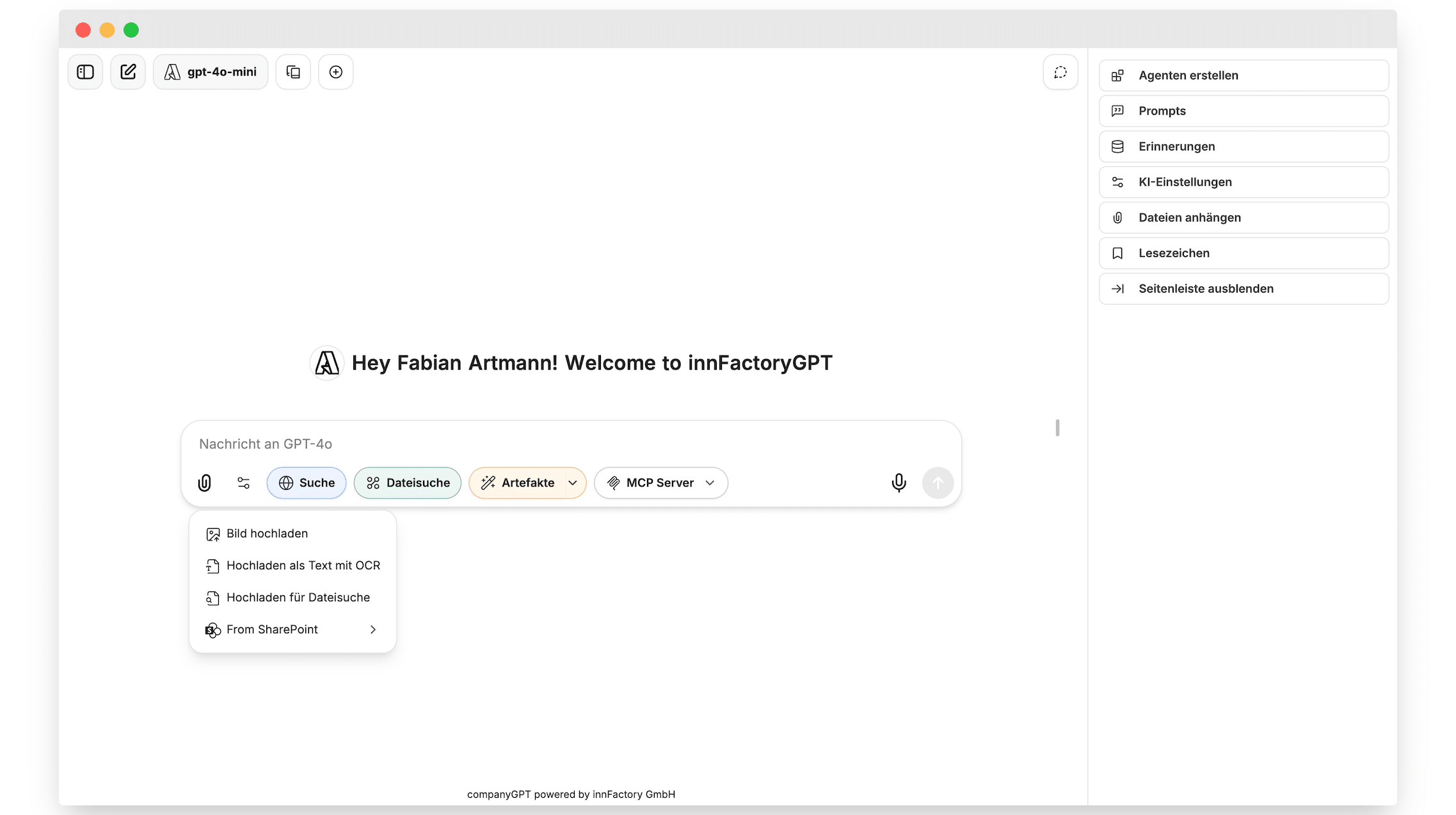

Eigene MCP-Server für echte Microsoft-365-Integration

Hier wird es spannend. Open Source liefert die Basis von CompanyGPT, aber Enterprise-Anforderungen lösen wir über eigene Erweiterungen. Im Zentrum stehen unsere MCP-Server, die das Model Context Protocol implementieren und tief in Microsoft 365 eintauchen.

Das wichtigste Beispiel ist der RAG-Service für SharePoint. Wenn ein Anwender im CompanyGPT eine Frage stellt, propagieren wir das Entra-Token bis zum MCP-Server. Dieser greift mit dem Token des Anwenders auf SharePoint zu. Das hat Konsequenzen:

- Die KI sieht ausschließlich Dokumente, die der Anwender ohnehin sehen darf

- Berechtigungen aus SharePoint bleiben vollständig erhalten

- Es gibt keinen Service-Account, der breite Lese-Rechte sammelt

- Audit-Logs in Microsoft 365 zeigen den echten Anwender, nicht einen technischen Bot

Diese Art der Integration findet sich in der Open-Source-Welt nicht. Sie entsteht erst, wenn man Identity, Tokens, MCP und Microsoft Graph zusammen denkt.

Weitere MCP-Server decken Outlook, Teams, OneDrive und individuelle Fachsysteme ab. Jeder Server folgt demselben Muster: Entra-Token rein, Berechtigungen prüfen, Daten kontextualisiert zurück.

Was Kunden davon haben

Aus Kundensicht ergibt sich daraus ein klares Bild:

- Eine private KI-Plattform im eigenen Tenant ohne Vendor Lock-in

- Volle DSGVO- und EU-AI-Act-Konformität durch europäische Regionen und souveräne Optionen

- Keine Lizenzgebühren, sondern nur Infrastruktur und Token nach Verbrauch

- Kontinuierliche Updates und Härtung über DevSecOps-Pipelines

- Tiefe Integration in Microsoft 365 mit korrekter Berechtigungsweitergabe

- Multi-Cloud-Modellauswahl über AI Foundry, Google Agents, Bedrock und STACKIT

Fazit

CompanyGPT ist kein weiterer ChatGPT-Klon. Es ist eine Enterprise-Plattform, die Cloud-Engineering, Identity, Compliance und KI zusammenführt. Der Cloud-Stack mit AKS, PostgreSQL, Cosmos DB, privaten Endpoints, Terraform und GitHub Actions ist exakt das, was wir auch in anderen Enterprise-Projekten bauen. Hier kommt die KI-Schicht und die tiefe Microsoft-365-Integration dazu.

Wenn Sie überlegen, eine eigene KI-Plattform aufzubauen, sprechen Sie uns an, bevor Sie das Rad neu erfinden. Wir kennen die Stolperfallen und haben den Pfad bereits sauber zementiert.

Demo anfragen oder direkt zu unseren Cloud-Leistungen wechseln.

Tobias Jonas

Tobias Jonas